۲۱ فروردین رگرسیون حداقل مربعات جزئی PLS

روش رگرسیون حداقل مربعات جزئی، PLS جایگزین خوبی برای رگرسیون خطی چندگانه و روش رگرسیون مؤلفههای اصلی است. این تکنیک زمانی استفاده میشود که میخواهیم تأثیرات چندین متغیر مستقل را بر یک یا چند متغیر وابسته بررسی کنیم اما پیش فرضهای انجام رگرسیون برقرار نیست. منشاء رویکرد حداقل مربعات جزئی به سال ۱۹۹۶ برمیگردد زمانیکه والد دو روش تکرار شونده با استفاده از برآورد حداقل مربعات برای مدلهای تک و چند جزئی و همبستگی کانونی ارائه داد.

هنگامی که در مدلهای خطی با مشکلات زیر مواجه شویم بکار بردن روش حداقل مربعات جزئی راهگشاست :

- چندین متغیر وابسته داشته باشیم.

- تعداد متغیرهای مستقل زیاد باشد حتی بیشتر از تعداد مشاهدات و شناسایی متغیرهای تأثیرگذار مشکل باشد.

- در متغیرهای مستقل همخطی وجود داشته باشد.

- حجم نمونه کم باشد.

- در رگرسیون، توزیع فراوانی متغیرها نرمال نباشد.

روش حداقل مربعات جزئی (Partial Least Square) میتواند تأثیرات متغیرهای مستقل را بر متغیر وابسته به صورت یک مدل رگرسیونی برازش کند. چنانچه هدف پژوهشگر پیشبینی باشد، استفاده از این روش توصیه میشود. این روش چون برای مقاصد اکتشافی کاربرد دارد به هیچ گونه پیش فرضی احتیاج ندارد.

جذابترین توصیف آماری برای روش حداقل مربعات جزئی توسط استون و بروکس (Stone & Brooks ) در سال۱۹۹۰ ارائه شد. آنها نشان دادند که PLS معادل است با یافتن توابع خطی از متغیرهای مستقل بهطور پیاپی که دارای بیشترین کواریانس با متغیر وابسته هستند، بطوری که هر تابع خطی با توابع قبلی ناهمبسته باشد. میتوان گفت حداقل مربعات جزئی خانوادهای از الگوریتمهای حداقل مربعات متناوب است که تحلیل مؤلفههای اصلی (PCR) و همبستگی کانونی را گسترش میدهد. برای رگرسیون متغیرهای Y روی متغیرهای مستقل X، هدف از بکاربردن روش حداقل مربعات جزئی، یافتن عوامل جدیدیست که نقش X را بازی کنند، این عوامل جدید اغلب متغیرهای پنهان نامیده میشوند که هر متغیر پنهان ترکیب خطی از متغیرهای مستقل X است.

مقایسه روش حداقل مربعات جزئی با رگرسیون مولفه های اصلی

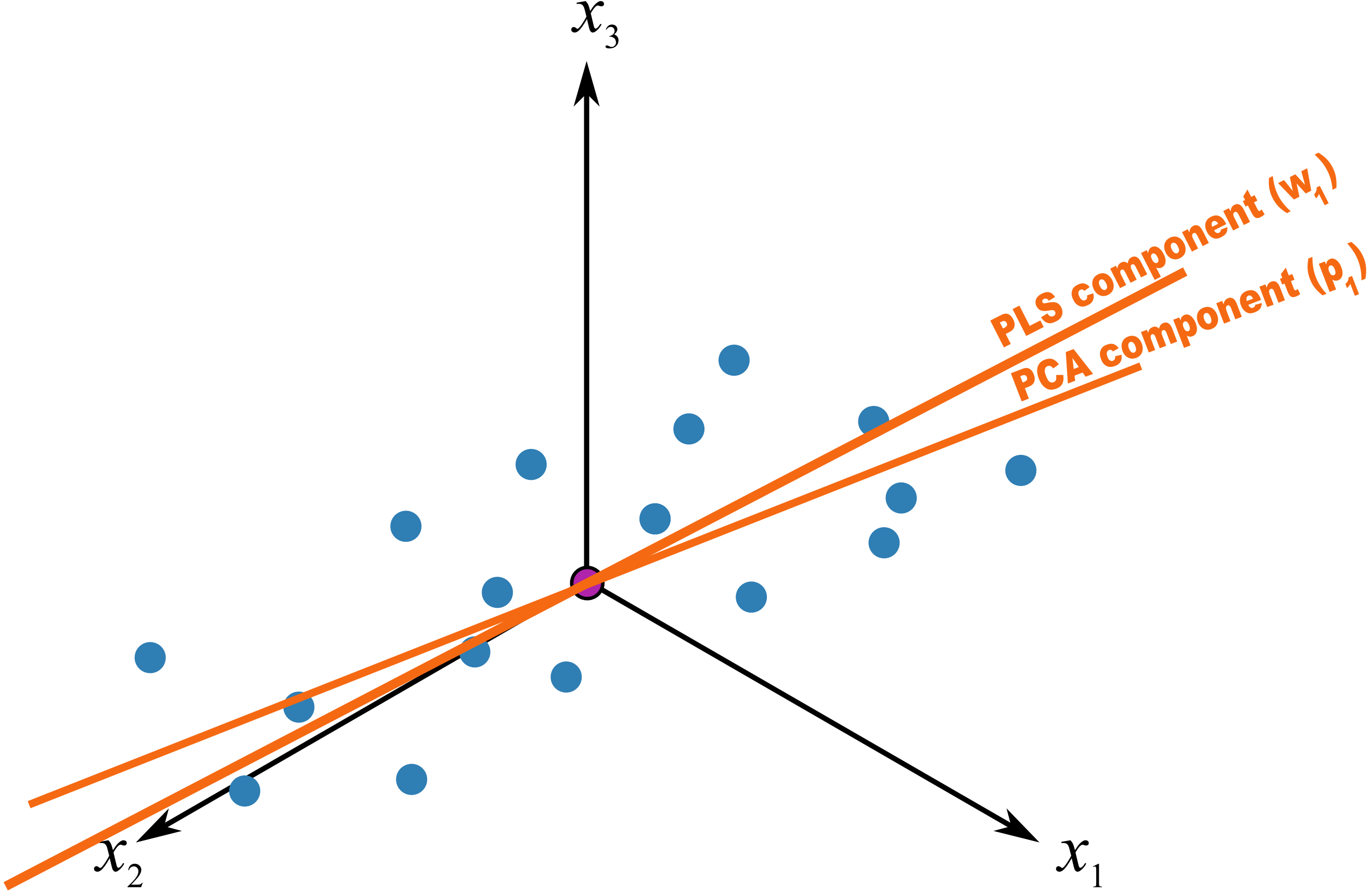

روش PLS شباهتهایی با روش PCR دارد. در هر دو روش برای پیدا کردن عواملی که با متغیر Y رگرسیون میشوند، تلاش شده است. تفاوت بزرگ این دو در این است که در حالت PCR فقط از متغیرهای X برای ساخت عوامل جدید استفاده میشود در حالی که در حالت PLS از هر دو متغیر X و Y برای ساخت عوامل جدید استفاده میشود که این عوامل نقش متغیرهای مستقل را بازی میکنند

در واقع حداقل مربعات جزئی ترکیب گستردهای از خصوصیات تحلیل مؤلفههای اصلی و رگرسیون چندگانه را شامل میشود. در PCR به دنبال پیدا کردن مؤلفههایی هستیم که بیشترین واریانس را از X دریافت کردهاند. یعنی در این روش مؤلفههای اصلی (PC) را، تنها از مقدار واریانس روی X تعیین میکنند، در حالی که این مؤلفهها هیچ نوع اطلاعاتی را در مورد متغیرهای Y دارا نیستند. همچنین در MLR به دنبال پیدا کردن مؤلفهای هستیم که بهترین همبستگی را بین متغیرهای وابسته و مستقل برقرار نماید. اما در PLS به دنبال یافتن مؤلفههایی هستیم که بتوانند علاوه بر ایجاد بیشترین واریانس، همبستگی را نیز بین متغیرهای وابسته و مستقل برقرار نمایند. در حداقل مربعات جزئی علاوه بر بردارهای امتیاز و بار یک ماتریس اضافی دیگر به نام وزن وجود دارد که به حفظ تعامد در مؤلفهها کمک میکند.

مزیت های رگرسیون PLS،

این روش در ابتدا بصورت یک الگوریتم برای محاسبه بردارهای ویژه به کار برده میشد اما به سرعت به یک معیار آماری تعبیر و تفسیر شد. بهطور خاص PLS به صورت یک مجموعه از متغیرهای پنهان که تجزیه همزمان Xو Y را با این شرط که این متغیرهای پنهان بیشترین مقدار ممکن کواریانس را بین X و Y بیان کنند، انجام میدهد. در حقیقت ایده کلی در PLS اینست که متغیرهای پنهان را پیدا کنیم. این متغیرهای پنهان کمی هستند که بیشتر، تغییرات متغیر پاسخ را توضیح میدهند.

گفتیم که روش تحلیل مؤلفههای اصلی براساس تجزیهی طیفی X’X و روش حداقل مربعات جزئی براساس تجزیهی مقادیر ویژه X’Y است. بنابراین اگر تعداد مؤلفه استخراج شده بزرگتر یا مساوی رتبه فضای نمونه باشد، روش PLS و MLR معادل خواهند بود.

در تکنیک PLS ، حذف خطا و شناسایی مؤلفهها ثانویه ماتریس جدید، از ماتریس متغیرهای مستقل و وابسته جهت تحلیل حاصل میشود. به همین جهت روش PLS ، روش مبنی بر مؤلفه نامیده میشود. این روش نسبت به روشهای غیرمبنی بر مؤلفه نظیر MLR در برخورد با دادههای تکراری، قویتر و تواناتر است.